Inilah Alasan Mengapa Jawaban Model AI Bahasa Seperti Meta AI, ChatGPT, Copilot, dan Gemini Sering Salah

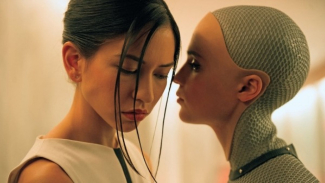

- Tangkapan layar

Jakarta, WISATA - Kecerdasan buatan (AI) telah menjadi bagian penting dari kehidupan modern, termasuk model AI berbasis bahasa seperti Meta AI, ChatGPT, Copilot, dan Gemini. Teknologi ini dirancang untuk membantu manusia dalam berbagai aspek, mulai dari menyelesaikan tugas sehari-hari hingga membuat keputusan bisnis yang rumit. Namun, di balik kehebatannya, sering kali muncul keluhan bahwa jawaban yang dihasilkan model-model ini tidak selalu akurat, bahkan bisa keliru. Mengapa hal ini terjadi? Mari kita kupas lebih dalam.

Cara Kerja Model AI Bahasa

Model AI bahasa dibangun menggunakan teknologi pembelajaran mesin (machine learning), khususnya teknik deep learning. Model seperti GPT (Generative Pre-trained Transformer) dilatih menggunakan kumpulan data teks yang sangat besar dari internet. Mereka menganalisis pola dalam data tersebut untuk memprediksi kata atau frasa berikutnya dalam sebuah kalimat.

Meskipun teknologi ini mengesankan, model AI tidak memahami konteks seperti manusia. Mereka hanya memproses data yang telah diberikan tanpa kemampuan untuk benar-benar "mengerti" apa yang sedang mereka sampaikan. Akibatnya, kesalahan sering muncul, terutama ketika menghadapi pertanyaan kompleks atau ambigu.

Sumber Kesalahan pada Jawaban AI Bahasa

Data yang digunakan untuk melatih model AI sering kali menjadi salah satu penyebab utama kesalahan. Model AI dilatih menggunakan data dari berbagai sumber di internet, yang sering kali tidak terverifikasi atau mengandung informasi yang usang. Data yang tidak akurat ini secara langsung memengaruhi kualitas jawaban yang dihasilkan. Jika sumber data yang digunakan mengandung bias atau kesalahan faktual, model AI cenderung mereplikasi kesalahan tersebut. Masalah ini diperparah oleh fakta bahwa sebagian besar data internet tidak memiliki mekanisme validasi yang ketat.

Selain itu, AI berbasis bahasa seperti Meta AI dan ChatGPT menggunakan algoritme prediktif untuk menjawab pertanyaan. Namun, mereka sering gagal memahami nuansa atau konteks spesifik. Sebagai contoh, jika pengguna memberikan perintah yang ambigu atau tidak lengkap, jawaban AI cenderung generik atau tidak relevan. Ketika diminta menjelaskan topik yang memiliki banyak makna atau sudut pandang, AI mungkin memberikan jawaban yang hanya mencakup salah satu aspek, meninggalkan informasi penting lainnya.