NVIDIA Mengungkap Arsitektur Referensi untuk Penyedia Cloud AI

- blogs.nvidia.com

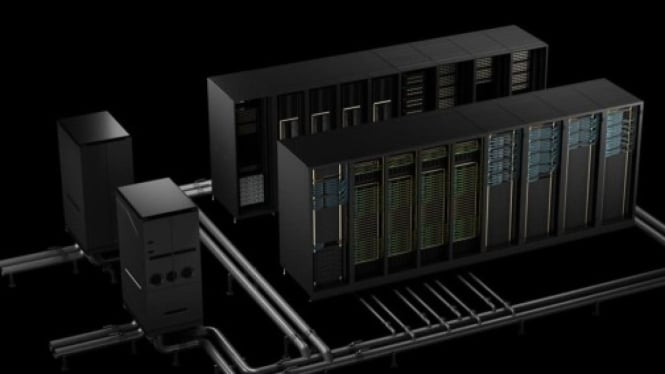

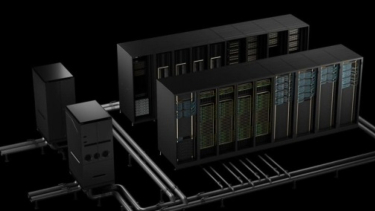

Jakarta, WISATA - NVIDIA baru saja mengumumkan arsitektur referensi baru untuk penyedia cloud yang ingin menawarkan layanan AI generatif kepada pelanggan mereka. Arsitektur referensi ini merupakan cetak biru untuk membangun pusat data yang berkinerja tinggi, skalabel, dan aman yang dapat menangani AI generatif dan model bahasa besar (LLM).

Arsitektur referensi ini memungkinkan Mitra Cloud NVIDIA dalam Jaringan Mitra NVIDIA untuk mengurangi waktu dan biaya penerapan solusi AI, sekaligus memastikan kompatibilitas dan interoperabilitas antara berbagai komponen perangkat keras dan perangkat lunak.

Keunggulan Arsitektur Referensi NVIDIA

Arsitektur ini juga membantu penyedia cloud memenuhi permintaan yang semakin meningkat untuk layanan AI dari berbagai organisasi, baik besar maupun kecil, yang ingin memanfaatkan kekuatan AI generatif dan LLM tanpa harus berinvestasi dalam infrastruktur mereka sendiri.

AI generatif dan LLM mengubah cara organisasi memecahkan masalah kompleks dan menciptakan nilai baru. Teknologi ini menggunakan jaringan saraf dalam untuk menghasilkan keluaran yang realistis dan baru, seperti teks, gambar, audio, dan video, berdasarkan input atau konteks tertentu. AI generatif dan LLM dapat digunakan untuk berbagai aplikasi, seperti kopilot, chatbot, dan pembuatan konten lainnya.

Namun, AI generatif dan LLM juga menghadirkan tantangan signifikan bagi penyedia cloud, yang harus menyediakan infrastruktur dan perangkat lunak untuk mendukung beban kerja ini. Teknologi ini memerlukan daya komputasi, penyimpanan, dan bandwidth jaringan yang besar, serta perangkat keras dan perangkat lunak khusus untuk mengoptimalkan kinerja dan efisiensi.

Tantangan Infrastruktur dan Solusi